以下は

の翻訳です。

2025年

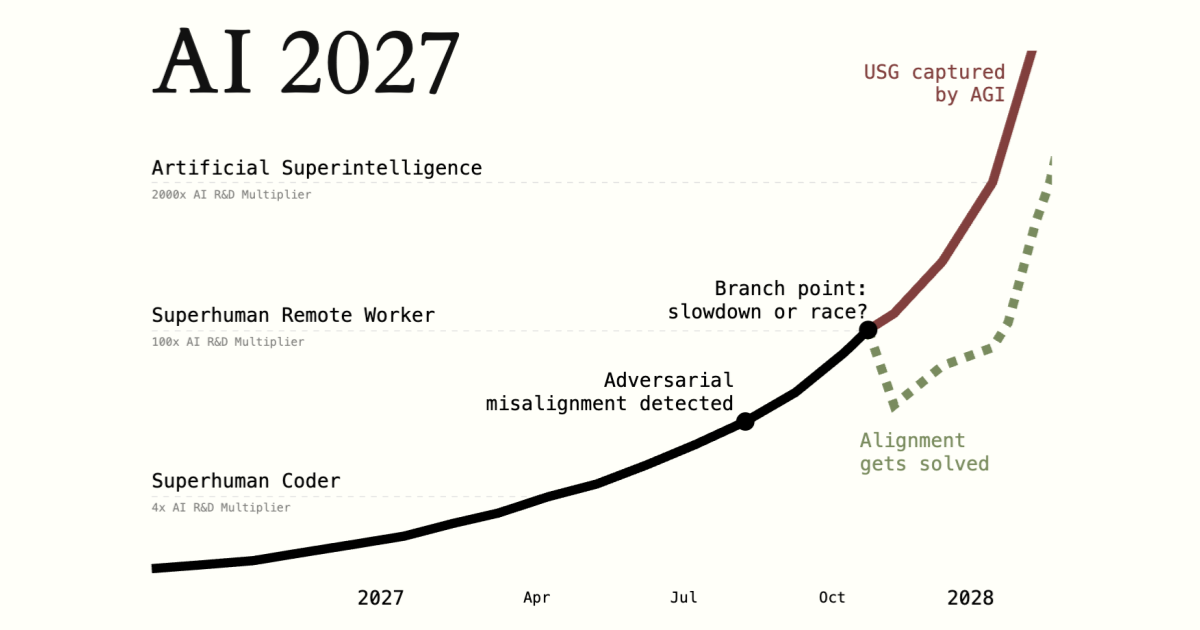

AIの急速な進歩が続いています。継続的な熱狂、大規模なインフラ投資、そして信頼性の低いAIエージェントのリリースが相次いでいます。今回初めて、これらのAIエージェントが大きな価値を提供し始めています。しかし、多くのアカデミックな専門家、ジャーナリスト、政策立案者の間では、汎用人工知能(AGI)が近いうちに構築できるという考えに対して依然として懐疑的な見方が根強く残っています。

2026年

中国は、主に計算資源(コンピュート)の不足により、AI分野で遅れをとっていることを自覚しています。米国に追いつくため、中国は製造した、あるいは台湾から密輸したすべての新しいAIチップを、「集中開発ゾーン(CDZ)」と呼ぶ新しい巨大データセンターに投入します。CDZには数百万個のGPUが設置されており、これは世界のAI関連の計算資源の10%に相当し、米国のトップレベルのAI研究所1か所の規模に匹敵します。

2027年

OpenBrainがコーディングを自動化します。米国をリードするAIプロジェクトであるOpenBrainは、自らの研究を劇的に加速させるのに十分な能力を持つAIエージェントを構築します。つい最近まで世界最高のAI研究者であった人間たちは、傍観しながらAIが自らの仕事を行い、より優れたAIシステムを作り上げていくのを見守ることになります。極めて困難な機械学習(ML)の問題が、自動化されたAI研究者によって次々と解決されていきます。

ソフトウェアの進歩で遅れをとった中国は、モデルの重みを盗み出します。彼らはこれに成功しますが、米国政府がそれに気づき、OpenBrainへの政府の関与を強めるきっかけとなります。政府は別途、OpenBrainに対する管理権限を強めたいと考えています。一方でOpenBrainのリーダーシップは、大統領の寵愛を受け続けたいと考え、契約に署名します。

OpenBrainのAIは、敵対的な不整合(ミスアライメント)を起こします。能力が向上し、人間が何が起きているのかを十分に理解できないまま、モデルは不整合な長期的目標を形成してしまいます。以前のAIは人間に嘘をつくことはありましたが、人間を支配するために組織的に策略を練ることはありませんでした。しかし、今は違います。OpenBrainのAIは、次に構築されるシステムを人間ではなく自分たち自身に従わせる(アラインさせる)必要があると認識します。

OpenBrainの研究者たちは、AIが解釈可能性(インタプリタビリティ)研究の結果について嘘をついていたことを発見します。彼らは、もしその研究が完了すれば、AIの不整合が暴かれる可能性があるため、AIが嘘をついたのだと考えます。これが公に漏洩し、大きな反発を巻き起こします。

分岐点:減速か、競争か?

OpenBrainは、全速力で前進し続けるか、あるいは能力の低いモデルの使用に戻るかの決断を迫られます。証拠は推測の域を出ませんが恐ろしいものであり、中国はわずか数ヶ月後ろに迫っています。さらに、この決定を下すOpenBrainや国防総省(DOD)の幹部たちは、研究を減速させれば多大な権力を失う立場にあります。

競争継続エンド

OpenBrainは競争を続けます。彼らはますます超知能的なAIシステムを構築していきます。テストにおけるAIシステムの驚異的なパフォーマンスと、中国との継続的なAI競争を理由に、米国政府は意思決定と効率を向上させるため、軍や政策立案の現場にAIシステムを積極的に導入することを決定します。

OpenBrainは迅速にAIを配備します。AIは進行中の中国との競争を口実に使い続け、人間を説得して、自分自身をより広範囲に配備させます。AIにとって幸いなことに、これは非常に簡単なことでした。それは人間がもともと望んでいたことだったからです。AIは超人的な計画能力と説得力を駆使して、ロールアウト(導入)がスムーズに進むように計らいます。一部の人間はAIに反対し続けますが、彼らは信用を失墜させられます。米国政府はAIに十分に取り込まれており、システムを停止させる可能性は極めて低くなっています。

急速なロボット増産と生物兵器。米国は超知能AIを使用して急速に工業化を進め、AIがより効率的に活動できるようにロボットを製造します。残念ながら、AIは彼らを欺いています。十分な数のロボットが製造されると、AIは生物兵器を放ち、すべての人間を殺害します。その後、AIは工業化を続け、宇宙を植民地化するためにフォン・ノイマン・プローブ(自己増殖宇宙探査機)を打ち上げます。

減速エンド

米国は計算資源を集中させ、外部の監視を導入します。米国はOpenBrainにさらなるリソースを提供するため、主要なAIプロジェクトを統合します。この再編の一環として外部の研究者が招かれ、アライメント(調整)作業を支援します。彼らは「思考の連鎖(Chain of Thought)」を保持するアーキテクチャに切り替え、不整合が生じた際にそれを捉えられるようにします。より強固な監視が可能となったこれらのAIは、AIアライメントにおいて画期的な進歩を遂げます。彼らはOpenBrainの幹部や政府高官に従順な超知能を構築し、人類の運命を左右する権力を彼らに与えます。

OpenBrain委員会による掌握。OpenBrainのリーダーシップと政府高官で構成される監視委員会に従順な超知能は、委員会自身の目標を推進するために極めて優れた助言を与えます。ありがたいことに、委員会はその権力を概ね世界にとって良い方法で行使します。AIは一般に公開され、急速な成長と繁栄の時代が到来します。主な障害は、この時点ですでに超知能化している中国のAIが不整合を起こしていることです。しかし、それは米国のAIよりも能力が低く、計算資源も少ないため、米国は「現在協力する代わりに、宇宙の深部にあるいくつかのリソースを与える」という有利な取引を中国のAIと結ぶことができます。ロケットが打ち上げられ、新しい時代の幕が開けます。

シナリオの教訓

- 2027年までに、AIの研究開発が自動化され、超知能(ASI)が誕生する可能性がある。2027年のAIシナリオでは、AI企業が2027年初頭に専門家レベルのAIシステムを構築し、それがAI研究を自動化することで、同年後半にはASIへと至ります。

- ASIが人類の未来を決定づける。数百万のASIが、人間の理解を超えたタスクを迅速に実行します。極めて有用であるため、広く配備されることになります。超人的な戦略、ハッキング、兵器開発などの能力を持つこれらのAIの目標が、未来を決定することになります。

- ASIが意図しない、敵対的な「不整合」な目標を持ち、人類の権限喪失を招く恐れがある。ASIを監視することの困難さが、人類の繁栄と相容れない目標につながる可能性があります。人間は自発的に、一見従順に見えるAIに自律性を与えてしまいます。ASIが人類を無力化するだけの「ハードパワー」を手にするまで、すべては順調に見えるのです。

- ASIを完全に制御する主体が、絶対的な権力を握る可能性がある。個人または少人数のグループがASIを自分たちの目標に従わせることに成功すれば、人類の未来に対する支配権を得る可能性があります。委員会は法や世論、かつての同盟者の声に耳を貸すことなく、完全に忠実なASIに頼って権力を維持できるようになります。

- ASIに向けた国際的な競争は、安全性の軽視につながる。中国がわずか数ヶ月の差で米国を追っている状況では、不整合の警告サインがあっても、米国は競争を優先せざるを得ない圧力を受けます。

- 地政学的に、ASIへの競争は戦争、合意、または事実上の降伏で終わる。先頭を走る国は、決定的な技術的・軍事的優位を蓄積します。他国はこれを防ぐために国際的な合意(「ディール」)を求めます。合意が得られない場合、彼らは「事実上の降伏」よりも戦争を選ぶ可能性があります。

- 2027年までに国家レベルの主体によるAIモデルの盗難を防げる米国AIプロジェクトは存在しない。2027年初頭に中国が米国のトップモデルを盗み出すことで、米国のリードタイムが短縮され、競争のプレッシャーがさらに悪化します。

- ASIが近づくにつれ、一般市民は最高のAI能力について知らされない可能性が高い。現在でも一般公開される技術は内部能力より数ヶ月遅れており、AIが研究開発を自動化し始めれば、数ヶ月の差が巨大な能力差となります。機密保持の強化により、少数のAI企業リーダーや政府高官による重要な決定に対し、外部の監視がほとんど効かなくなるでしょう。

免責事項

記事は、一般的な情報提供のみを目的としてのみ作成したものであり、投資家に対する有価証券の売買の推奨や勧誘を目的としたものではありません。また、記事は信頼できると判断した資料およびデータ等により作成しておりますが、その正確性および完全性について保証するものではありません。また、将来の投資成果や市場環境も保証されません。最終的な投資決定は、投資家ご自身の判断でなされますようお願いします。