の翻訳です。

Introduction

経営幹部たちは長らく、組織に技術を当てはめる際の枠組みとして、シンプルな分類に依存してきました。すなわち、ツールはタスクを自動化し、人間は意思決定を行い、戦略がこの二つをいかに連携させるかを決定するというものです。しかし、この枠組みはもはや十分ではありません。エージェント型AIという新しい種類のシステムが登場し、これらの境界を複雑化させています。これらのシステムは、自ら計画を立て、行動し、学習することができます。これらは単に操作されるツールや、指示を待つアシスタントではありません。ますます、マルチステップのプロセスを実行し、状況に応じて適応できる自律的なチームメイトのように振る舞っています。特筆すべきは、私たちのグローバルな経営幹部調査の回答者の76%が、エージェント型AIをツールというよりも同僚のように見ていると述べていることです。

戦略担当者にとって、エージェント型AIがツールとコワーカーの両方の性質を持つことは、新たなジレンマを生み出します。単一のエージェントが、ルーチン的なステップを引き継いだり、分析によって人間の専門家をサポートしたり、意思決定権限を移行させる形でワークフローを超えて協働したりする可能性があります。このツールとコワーカーの二重性は、技術が代替するか補完するか、自動化するか拡張するか、労働力か資本か、ツールか労働者か、のいずれか一方であると想定する従来の管理ロジックを崩壊させます。組織は今、人的資源のアプローチと資産管理技術の両方を要求する単一のシステムを管理するという、前例のない課題に直面しています。

ほとんどの組織内での技術と戦略の分離が、この課題を悪化させています。技術部門の幹部は、パイロット、ベンダー、またはインフラストラクチャの決定を行い、技術的な問題に焦点を当てます。戦略部門の幹部は、市場、競争、人材に焦点を当てます。しかし、エージェント型AIは、その分離を持続不可能にします。それは、プロセスの設計、役割の構造、意思決定権限の配分、および説明責任の文化に同時に影響を与えます。

採用の津波と戦略の滴り

テクノロジーが広範な影響を持つにもかかわらず、組織は戦略を確立するずっと前から、エージェントAI(Agentic AI: 自律的に動作するAI)を急速に採用しています。

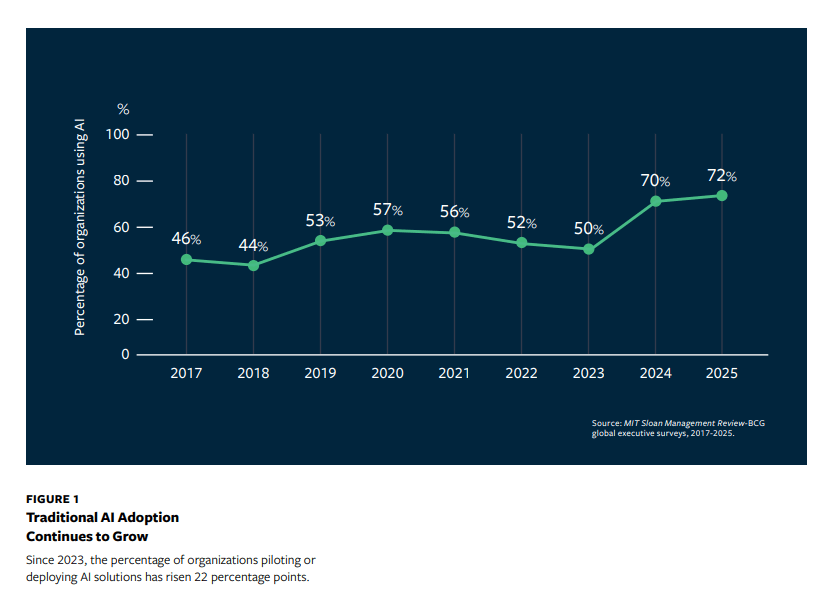

私たちの調査によると、従来のAIの採用率は過去8年間で72%に上昇しました(図1を参照)。生成AI(Generative AI)はわずか3年間で70%の採用率を達成しました。そして、わずか2年間で、エージェントAIはすでに35%の採用率に達しており、さらに44%の組織が近いうちに導入を計画しています。ベンダーは、提供する製品にエージェント機能を組み込むことでこの傾向を加速させており、その結果、組織は戦略的な管理フレームワークを開発する前にエージェントAIを実装しています。

その結果として、戦略的なリスクが増大しています。エージェントAIは、リーダーがプロセスを再設計したり、意思決定の権利を割り当てたり、労働力モデルを再考したりするよりも速いスピードで企業全体に広がっているのです。

世界的な調査で2,000人以上の回答者と主要な経営者へのインタビューに基づいた私たちの調査では、組織がエージェントAIから価値を得るための複数の選択肢があることが判明しました。これは、コスト効率の改善だけでなく、収益の拡大、イノベーションの加速、学習曲線の圧縮、そして組織の再構築の可能性をもたらします。これらの目標を整合させる戦略的なアプローチがなければ、組織は投資に対するリターンを限定してしまうリスクがあります。

経営幹部のジレンマ

エージェントAIが「ツール」と「同僚」という二重の性質を持つことで、既存の管理フレームワークでは解決できない、組織内の相反する圧力が生まれています。

- ITリーダーは、予測可能でスケーラブルな、明確な技術仕様を持つシステムを望んでいます。

- CFOは、測定可能なリターンと減価償却スケジュールを持つ投資モデルを必要としています。

- HR幹部は、業績管理フレームワークと監督プロトコルを求めています。

- ビジネスリーダーは、同じシステムに対して効率性と適応性の両方を要求します。

これらの相反する要求は、単なる実装の課題ではありません。これらは、組織の差別化の新たな源泉を露呈する戦略的な要請です。エージェントAIを広範囲に利用している組織の間では、73%がAIの利用が自社の際立つ能力を根本的に高めると信じており、従業員の76%はそれが個人が同僚と差別化する方法を変えると信じています。

組織と個人がエージェントAIを利用して差別化できるのは、エージェントAIが従来の管理フレームワークに適合しない方法を利用できるようになったからです。

ツールのような自動化を通じてコスト削減をもたらす同じシステムが、

- ワーカーのような適応性を介して収益拡大を可能にし、

- 継続的な学習を介してイノベーションの加速を可能にし、

- 人間とエージェントの相互作用を介して組織的な学習を可能にします。

しかし、これらの複数の価値源にアクセスするには、既存のフレームワークでは対処できない運用上の緊張(Tension)を乗り越える必要があります。

前進するためには、従来の管理アプローチの不十分さを露呈する4つの運用上の緊張を理解し、その後、エージェントAIの固有の二重性に逆らうのではなく、それと共に機能するように、基本的なプロセス(仕事の設計、ガバナンス、労働力計画、学習、投資)を再設計することが必要です。本レポートは、どのように進めるべきかについて証拠に基づいた提言を提供します。

エージェントAI導入時の戦略的な緊張

経営幹部が直面する相反する圧力は、抽象的な理論上の問題ではありません。それらは、日々の業務における具体的で和解しがたい対立として現れます。

私たちの調査では、組織がエージェントAIを既存のワークフローに統合しようとするときに生じる、4つの明確な緊張を特定しました。それぞれの緊張は、確立された管理原則間の根本的な衝突を表しており、リーダーに、互換性のないアプローチを適用するか、あるいは完全に新しいハイブリッドなフレームワークを開発するかの選択を迫ります。この課題をうまく乗り越えるには、リーダーが以下の緊張を管理する必要があります。

- スケーラビリティ vs. 適応性: ツールは予測可能にスケールしますが、ワーカーは動的に適応します。エージェントAIがその両方を同時に行う能力は、新しい組織設計原則を必要とします。

- 経験 vs. 迅速性: エージェントシステムに投資する適切なタイミングはいつか、そしてその投資はどのように行うべきか?リーダーは、長期的な能力構築と短期的なリターンのバランスを取ることに直面しています。

- 監督 vs. 自律性: 自律的に動作するように設計されたものを、どのように監督するのか?従来の監視モデルは、完全な人間による制御か、完全な自動化のいずれかを前提としており、一部の人間の制御と異なる程度の自動化を必要とするシステムを前提としていません。

- 改修 vs. 再設計: 組織はプロセスをいつ、どの程度変更すべきか?その決定には、ほとんどの変更管理フレームワークでは対処されていないリソースと注意が必要です。

成功する組織は、エージェントAIの二重の性質を「バグ」ではなく「特徴」として認識する組織です。この曖昧さを受け入れ、システムを既存の管理カテゴリに押し込めるのではなく、ハイブリッドなアプローチを開発する戦略は、そのツールのようなスケーラビリティと、ワーカーのような適応性の両方から恩恵を受けます。

1. 柔軟性の緊張:スケーラビリティ vs. 適応性

人間のワーカーは最大限に柔軟です。彼らは、タスクを切り替え、新しいスキルを学び、予期せぬ状況に適応することが、最小限の再訓練で可能です。ツールはそれほど柔軟ではありません。機械やインフラストラクチャは特定の目的に優れており、予測可能にスケールしますが、変化への適応には苦労する可能性があります。エージェントAIはその中間に位置します。ツールよりも適応性が高いですが、(現状では)ワーカーよりも柔軟性はありません。組織は中間的な柔軟性を持つプロセスをどのように設計すべきでしょうか?

エージェントAIが予測可能にスケールし、動的に適応する能力は、既存の管理システムにきれいに収まらない新しい組織設計原則を必要とします。

Goodwill Industriesの賑やかな仕分け施設の中心では、ヴィンテージTシャツ、デザイナーズジーンズ、忘れられた布地が混沌と混ざり合った寄付品の川が絶え間なく流れています。専門のワーカーチームがこの繊維の山を苦労してふるいにかけていますが、AIエージェントがますますサポートできるようになっています。このシステムは、いくつかの特定のアイテムだけを認識するように厳密にプログラムされた単純なコンピュータービジョンマシンではありません。そうではなく、それは絶えず変化する商品の流れから継続的に学習し、適応する柔軟なAIです。これは、カシミヤのセーターとウール混紡を区別することを学び、一般的なおもちゃの中から珍しい収集品を特定し、さらには再販には不適切かもしれない摩耗や損傷の微妙な兆候さえも見つけることができます。

Goodwillの社長兼CEOであるSteve Preston氏は次のように述べています。「私たちのサプライチェーンは最初から最後まで非常に複雑であり、多くの人間の介入、多くの決定点、そして多くの判断を必要とします。そのため、このプロセス全体を通じて、私たちはAIを商品の流れ全体、意思決定プロセス、そして受け取ったすべてがサイクル内のどこかで最良の居場所を見つけることを確実にするために組み込む多くの機会を見ています。」

Goodwillは、最終的に毎年数十億ポンドの寄付品の仕分けに使用できるAI技術を試験的に導入しており、各アイテムがブティック、オンラインストア、またはリサイクル施設のどこであろうと、適切な場所にたどり着くことを確実にしています。AIが複雑な判断タスクを処理できる能力は、リーダーに数十年続いた人間中心のワークフローを新しいプロセスに置き換えることを促しています。彼らは、エージェントAIのため、そしてエージェントAIと共にプロセスを設計し始めています。

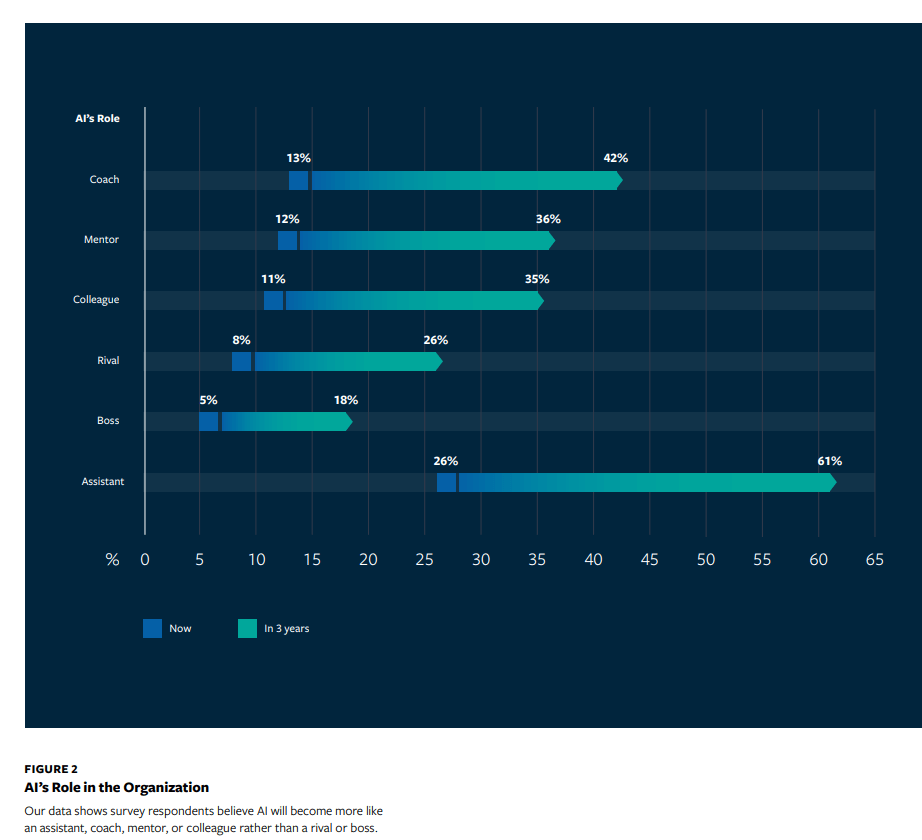

AIシステムはすでに、アシスタント、同僚、メンター、コーチ、さらにはライバルや上司としても機能しています。私たちの調査回答者の大半は、AIが3年以内にこれらの役割のそれぞれにもっと関与するようになると予想しています(図2、6ページを参照)。

ワーカーの構成が変化するにつれて、スケーラブルで柔軟なAIワーカーを導入することは、企業全体のプロセス設計にとって戦略的な緊張を生み出します。エージェントシステムは標準化された環境で最適に機能するかもしれませんが、過度な標準化は、彼らが学習し、人間のような適応性—エッジケースやシステム障害に対処するのに役立つ能力—を発展させる能力を排除してしまう可能性があります。組織は、標準化されたプロセスの効率性と、人間のような即興の柔軟性の両方を必要とします。

- 脅威: AIの効率性を追求して最適化する組織は、システム障害や予期せぬ市場の変化に対するAIの人間のような適応的な対応を見逃してしまいます。

- 機会: 適切なバランスを見つける企業は、AI主導の効率性と人間主導の適応性の両方を達成し、戦略的な利益を生み出すことができます。

なぜエージェント型AIはこれほど速く普及するのか

エージェント型AIの急速な導入は、なぜ一部の技術が他の技術よりも速く普及するのかを説明する、イノベーション普及理論と完全に一致しています。この枠組みによると、イノベーションは、明確な相対的優位性を提供し、既存のシステムと互換性があり、試行が簡単で、目に見える結果が得られる場合に、より迅速に普及します。

エージェント型AIは、これら四つの側面すべてにおいて優れています。これは、組織がすでに採用しているジェネレーティブAIの親しみやすさを基盤とし、広く使用されているプラットフォームにシームレスに統合され、実験のための新しいインフラを最小限しか必要とせず、即座に目に見える生産性の利益をもたらします。Chevronの最高データ・分析責任者であるMargery Connor氏が説明するように、「会社が単一ベンダーのプラットフォームに標準化されているため、労働力の半分以上がAIツール、ひいてはエージェント型AIにアクセスできます。」インフラはすでに整っているのです。

この組み込み型の利用可能性は、導入への障壁を劇的に減らします。従業員は、全く新しいシステムを導入することなくエージェント機能の使用を開始でき、組織全体での自発的な実験を促進します。より多くの人々が具体的な利益を体験するにつれて、口コミや実証効果を通じて導入が加速します — これは普及理論が正確に予測することです。

リーダーへの示唆:エージェント型AIの急速な普及は偶然ではありません。それは、この技術が導入の摩擦を最小限に抑えるように設計されているために起こっています。これは、競争上の利益が技術への早期アクセスからではなく、それを中心とした優れた組織設計から生まれることを意味します。

2. 投資の緊張:経験 vs. 迅速性

従来のツールは、多額の初期費用を必要としますが、確立された減価償却スケジュールを通じて予測可能なリターンをもたらします。人間のワーカーは継続的な変動費ですが、彼らの価値は経験と訓練によって高まります(Appreciate)ます。

エージェントAIは、これら両方のモデルに反します。多額の初期開発コストと、新しいデータに対するモデルの訓練のような継続的な変動費が必要です。多くの技術システムは継続的なメンテナンスを必要としますが、エージェントAIシステムは、モデルのドリフト(Model drift: 性能低下)によって減価償却されると同時に、ファインチューニングと創発的な能力によって価値が高まる(Appreciate)という側面を併せ持っています。

エージェントAIへの投資は、ツールへの投資とワーカーへの投資のどちらとして、あるいは両方として、より見なされるべきでしょうか?

この問いに正面から取り組むことで、従来の財務計画に課題を投げかける2つの重要な投資の緊張が明らかになります。

タイミング:動く的の問題(The moving-target problem)

AIシステムは急速に進化しており、組織がいつそれらに多大な投資を行うべきかについて不確実性をもたらしています。導入が早すぎれば、技術的陳腐化のリスクがあり、待ちすぎれば、戦略的利益を逃すリスクがあります。

LexisNexis Legal & Professionalのエグゼクティブバイスプレジデント兼技術会長であるJeff Reihl氏は、「このテクノロジーは非常に速く変化しているので、私たちは迅速なキャッチアップをしなければならないかもしれません」と述べています。

Chevronの最高データ・分析責任者であるMargery Connor氏も、この感情に同調し、新しいツールやアップデートへの適応性を維持する必要性について次のように述べています。「エージェントAIの急速な発展は、組織がデータとAIのガバナンス基準を一貫して維持しながら、アジャイルである(機敏に対応する)ことを要求します。」

予測可能なアップグレードサイクルを持つ従来のツールとは異なり、エージェントAIは継続的な適応と学習を必要とします。最も価値のあるアプリケーションがまだ構想されていない場合、標準的な正味現在価値(NPV)の計算は失敗します。また、従来のタイミングモデルは、技術進化のスピードを考慮に入れることができません。さらに、従来のシステム交換スケジュールを適用すると、システムが技術曲線から遅れるにつれて、価値が急速に失われるリスクがあります。

規模:プラットフォーム vs. ポイントソリューション

大組織は根本的な選択に直面しています。それは、包括的なAIプラットフォームに多額の投資を行うか、それともより小さく、特定の目的を絞ったポイントソリューションを追求するかです。

それぞれのアプローチに必要な投資の規模は劇的に異なる可能性があり、初期費用と継続的なコストを正確に評価することを困難にしています。

プラットフォームへの投資は、不確実なリターンを伴う多大な初期コミットメントを要求します。Capital Oneのエグゼクティブバイスプレジデント、チーフサイエンティスト、およびエンタープライズAI責任者であるPrem Natarajan氏は、単一の大規模なプラットフォーム投資から「数十のユースケースを規模をもって」構築していると述べています。Capital Oneの戦略の全体的な影響は、技術の活用(exploitation)と探索(exploration)というレンズを通して評価できます。

同様に、SAPの上級副社長兼AIグローバルヘッドであるWalter Sun氏は、「生成AIハブ」を作成することで、大規模言語モデル(LLM)の完全なライフサイクル管理が可能になると説明しています。一方で、LLMを個別のアプリケーションに単独で組み込むには、リターンが実現する前に、レガシーシステムの高コストな統合が必要になります。Sun氏は、SAPは開発者エコシステムへの価値に焦点を当て、それを使用してプラットフォームを持つことからの十分なリターンを決定したと述べています。

ポイントソリューションへの投資は、より予測可能なコストと測定可能なリターンを提供しますが、AI機能がビジネス機能全体に統合されたときに生まれる複合的な価値を見逃すリスクがあります。この道を選択する組織は、スケールアップや適応のためのインフラストラクチャを持たない、数十の分断されたAIツールを管理することになるかもしれません。

ヒューマン・イン・ザ・ループ(Human-in-the-loop)システムであろうと、完全に自律的なエージェントであろうと、どちらか一方のアプローチのみに投資している組織は、複数の意思決定シナリオにおけるエージェントAIの貢献によって生み出される複合的な価値を逃します。各自律レベルは、異なるリスク許容度とビジネスコンテキストに対応しますが、ROIを個別に測定することは、多様なAIポートフォリオの戦略的価値を不明瞭にします。

エージェントAIのハイブリッドな特徴は、意味のある期間にわたって投資リターンを正確に測定すること、あるいは初期投資要件を評価することさえも困難にしています。エージェントAIのリターンを従来の減価償却スケジュールで測定する企業は、これらのシステムが生み出す継続的な学習能力と創発的な能力を組織的に過小評価し、実際の価値創造の重要な部分を考慮に入れていません。

- 脅威: 従来型の投資フレームワークをエージェントAIに適用する組織は、継続的な学習と適応への投資を組織的に過少に行い、その結果、価値が急速に減衰すると同時に、統合されたAIエコシステムから得られる複合的なリターンを逃します。

- 機会: ハイブリッドな投資モデルと多様なAIポートフォリオを受け入れる企業は、システムが学習し、適応し、複数の自律レベルとビジネスコンテキストにわたって予期せぬ能力を生み出すにつれて、複合的なリターンを生み出すことができます。競争圧力が高まり、技術進化が加速するにつれて、この戦略的優位性を確立するための時間は短くなっています。

問題は、これらの緊張を解決するかどうかではなく、むしろ、組織がエージェントAIの現実に合わせて投資フレームワークをどれだけ迅速に適応させるかということです。

3. 制御の緊張:監督 vs. 自律性

ツールは完全に所有・制御され、展開後は予測可能に動作します。ワーカーは自律性を持っており、異なる目標を追求する可能性があるため、契約、インセンティブ、および監督を通じて管理する必要があります。

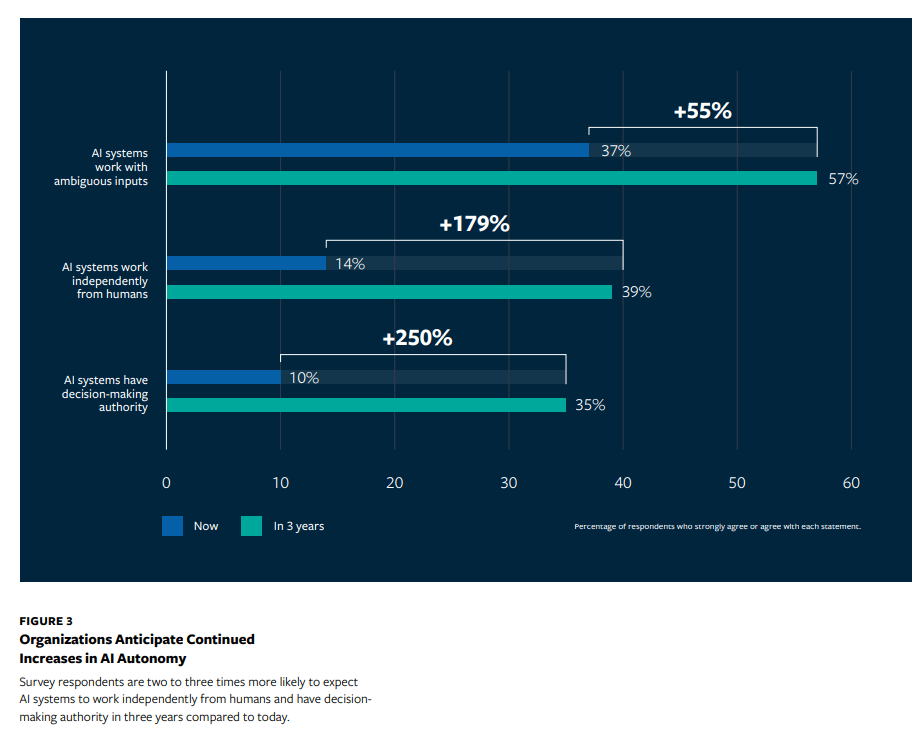

エージェントAIは、組織が自律的なツールとして所有しているにもかかわらず、その出力が予測不可能になる可能性があるため、ワーカーと同じように監督と管理を必要とします。組織は、自律的に動作するエージェントを効果的に監督するためのプロセスをどのように設計できるでしょうか?(図3を参照)

監督を含むプロセスは、本質的に人間を意思決定プロセスに関与させます。ChevronのConnor氏は、「私たちは常にヒューマン・イン・ザ・ループ(Human-in-the-loop: 人間が関与する仕組み)を置き、アウトプットをレビュー・分析して、それが理にかなっているかどうかを判断できるようにしています」と述べています。Truist Bankの元生成AI、機械学習、分析責任者であるChandra Kapireddy氏は、「金融サービス業界を見ると、顧客に面しており、人間が関与せずに私たちが下す決定に影響を与えるユースケースは実際にはないと思います」と述べています。

テクノロジーを所有しているにもかかわらず、組織はエージェントAIシステムを、通常は人間の従業員にのみ適用されるのと同じ監視体制で扱う必要があります。

しかし同時に、組織は、人間の監督がボトルネックを作り出すのを避けながら、AIエージェントが提供できるスケールの恩恵を望んでいます。私たちが話を聞いたあるリーダーは、「適切な一連のコントロール(制御機能)を確実に導入するにはどうすればよいでしょうか?私たちはそれを『ヒューマン・イン・ザ・ループ』、あるいは低リスクのユースケースでは『ヒューマン・アウト・オブ・ザ・ループ』と呼んでいます」と尋ねました。

低リスクのユースケースでヒューマン・アウト・オブ・ザ・ループに移行するという決定には、コンテキストに依存したリスク評価が伴います。機能が固定された単純なツールとは異なり、エージェントAIは、その行動が意図しない結果をもたらす可能性がある複雑な環境で動作します。

これは、組織の行動が戦略的目標と整合し、負の結果が防止されるように、意思決定と行動の境界を設定するポリシーを組織が作成し、セーフガードとして機能させる必要があることを意味します。これは、人間の従業員に対してポリシーを設定し、監督を提供することに類似しています。

SAPのSun氏は、この目的のために生成AIハブを構築することについて次のように説明しています。「それを通じて、私たちはさまざまな大規模言語モデルに接続できます。しかし、私たちはまた、すべてのビジネスアプリケーションにガードレールを設置する能力も持っています。独自の分析、独自のセキュリティ、プライバシー、コンプライアンスなどを導入できるのです。」これらの制御の必要性は、AIが完全に予測可能なツールではなく、管理者が導き、制約する必要があるエージェントであることを強調しています。

ツールが誤作動した場合、それは欠陥です。同僚が間違いを犯した場合、それは管理と学習の機会です。マネージャーはこの「同僚」の考え方をAIに適用できます。

Partnership on AIのCEOであるRebecca Finlay氏は、企業がAIの失敗についてもっと透明性を高める必要があると主張しています。「私たちは、何がうまくいかなかったのかについてもっと共有できる立場になることを望んでいます。なぜなら、その共有の中にこそ、学習があるからです。」このアプローチは、AIを間違いを犯さないツールとしてではなく、そのエラーが理解され、管理され、そこから学習されなければならないエージェントとして扱います。この学習プロセスは、効果的なチームが人為的エラーを処理する方法に並行しています。

- 脅威: エージェントAIに対して適切なガバナンスフレームワークを開発できなかった組織は、コンプライアンス違反、不適切な出力、あるいはビジネス運営に損害を与える暴走システムに直面する可能性があります。

- 機会: 人工的な同僚を管理する技術を習得した企業は、従来の人間の採用、訓練、定着といった制約なしに、専門的な能力を規模拡大することができます。

4. スコープの緊張:改修(Retrofit) vs. 再設計(Reengineer)

エージェントAIは、リーダーに対し、リソース配分に関する重要な選択を提示します。これは、技術変化の急速なペースによってさらに複雑になっています。その選択とは、迅速な段階的利益のためにAIを既存のワークフローに改修(Retrofit)するか、それともより革新的だが時間がかかる結果のためにプロセスを再設計(Reengineer)するかです。

改修は、通常、時間と資本が少なくて済み、現在のテクノロジーでより速いリターンをもたらします。対照的に、再設計は、より長い期間にわたるリソースの重大なコミットメントを必要とします。この長期にわたるタイムラインは、新しいリスクを生み出します。プロジェクトが完了する前に基盤となるAI技術が大幅に進歩し、ローンチ時に新しいプロセスが時代遅れになる可能性があることです。

これは複雑なトレードオフを強います。長期的な再設計プロジェクトにコミットするということは、他のより速い最適化プロジェクトを諦めるだけでなく、今日のテクノロジーの寿命に賭けることも意味します。完全なオーバーホールにコミットする前に、より強力で安定したプラットフォームを待って、今、より小さな段階的な改善を行い、意図的に技術世代をスキップする方が、より戦略的である可能性があります。

リーダーは、プロセスの段階的な改善を行うべき時と、AIの能力を中心にプロセス全体を再設計すべき時を、どのように決定すべきでしょうか?

Goodwillのテキスタイル仕分けへのAI利用は、一見すると単純なプロセス改善に見えます。しかし、Preston氏のコメントは、はるかに大きな野望を明らかにしています。同組織の何十億もの固有のアイテムと多数の決定点を含むオペレーションの複雑さは、AIの可能性が単一のタスクを速く行うことだけでなく、商品全体の流れを根本的に変えることにあることを示唆しています。これはジレンマを提示します。組織はAIを単に仕分けを改善するために使用すべきでしょうか、それとも寄付から最終販売またはリサイクルに至るサプライチェーン全体を再設計すべきでしょうか?

Preston氏は、Goodwillが仕分けAIをより活用するために、積極的にオペレーションを再設計していると述べています。「商品が何か、その商品にとって最良の居場所はどこか、そしてそれをどのように経路指定するかというプロセス全体には、いかなる数のAIアプリケーションも関与する可能性があります」と彼は述べています。一見すると段階的なAIの適用(仕分け)が、数十年前の人間中心のワークフローの構造そのものに疑問を呈した後、サプライチェーンの完全な再設計への扉を開きました。

- 脅威: エージェントAIを段階的な改善に限定する組織は、革新的な機会を逃す可能性があります。しかし、大規模な再設計には、かなりのリソースと時間がかかることがあります。

- 機会: エージェントAIを中心にワークフローに疑問を呈する企業は、競合他社と差別化できる新しい能力を生み出すことができます。

ワークフロー、ガバナンス、役割、および投資の戦略的なオーバーホール

エージェントAIの二重の性質によって生み出される緊張は、段階的な調整を超える戦略的な対応を必要とします。従来の機能別サイロ内で管理できるテクノロジーとは異なり、エージェントAIは組織内の内部境界を横断します。

例えば、

- 技術的な展開にはITの専門知識、

- 業績管理にはHRのようなフレームワーク、

- ハイブリッドな投資には財務モデル、

- 自律的な意思決定には法的監督、

- ワークフロー統合にはビジネスユニットの調整が必要です。

4つの基本的な緊張のどれも、単一の機能が単独で行動することで解決することはできません。それぞれの緊張は、産業化の始まり以来組織の構造を定義してきた部門の境界を超越する、新しい形態の幹部間の協働を必要とします。

これらの緊張は、単なる運用上の課題ではなく、組織がどのように価値を創造し、自らを構造化し、意思決定を統治し、人間と非人間の貢献者の両方を管理するかについての戦略的な疑問を露呈しています。経営幹部は、エージェントAIがコスト削減のみを意図しているのか、それともイノベーション、差別化、組織学習の源泉として、より幅広い価値をカバーできるのかを問うことを余儀なくされています。彼らの答えが、プロセスの設計、構造、ガバナンス、および労働力戦略をどのように設計するかを決定します。

経営幹部が、効率性、成長、イノベーション、またはそれらの組み合わせなど、エージェントAIから得たい価値を定義したら、意識から行動へと移行するために、互いに連動する5つのインプリケーションに対処する必要があります。

1. 仕事の再設計:段階的な改善を超えて

エージェントAIの台頭は、孤立したタスクだけでなく、ワークフロー全体を再構築するでしょう。CEOにとっての中心的な問題は、もはや「どこを自動化できるか?」ではなく、「プロセス設計そのものが根本的にどう変わるか?」です。エージェントシステムは、単に既存のステップを速くするだけでなく、レガシープロセスが収容するように構築されていなかった方法で、人間の判断と機械の自律性を融合させたワークフロー全体の設計を再考するようにリーダーを誘います。

経営幹部はこの変化の規模を熟考すべきです。組織に500のプロセスがある場合、いくつが再考されるでしょうか—50?200?400?エージェントAIを広範囲に採用している組織は、答えが高い方の数値に遥かに近いことを示唆しています。私たちの調査では、エージェントAIを広範囲に採用している組織の**66%がオペレーティングモデルの変更を予想しているのに対し、採用計画がない組織では42%**でした。(付録図1、19ページを参照。)この統計は、より複雑な現実を覆い隠しています。成功する組織は、スコープと柔軟性の緊張を解決するのではなく、効率性と適応性の間で破綻することなく揺れ動くことができるワークフローを設計しています。

ADPのチーフプロダクトオーナーであるNaomi Lariviere氏は、このアプローチの例を提供しています。給与計算タスクを改修するか、プロセス全体を再設計するかを選択するのではなく、ADPは**その両方を同時に可能にする独自の「エージェント構築プラットフォーム」**を構築しました。個々の給与計算タスクは効率性のために最適化される一方(スケーラビリティのニーズに対応)、プラットフォームのアーキテクチャは、何百もの地域で税法が変更されたときに新しい能力を迅速に展開することを可能にします(適応性のニーズに対応)。このプラットフォームは、効率性と柔軟性の間の緊張を排除するのではなく、両方の要求を継続的に管理するためのインフラストラクチャを作成します。

人々は、AIが3年後には彼らの仕事の2倍をこなすようになると信じています。現在、人々はAIが1年前に比べて自分の仕事のタスクの23%多くをこなしていると感じています。しかし、3年後には、AIが自分の仕事のタスクの**46%**をこなせるようになると予想しています。プロセスは変わる必要があります。

同様に、Goodwillの経験は、組織がそれを防ごうとするのではなく、スコープのエスカレーションに備える方法を明らかにしています。時間が経つにつれて、テキスタイル仕分けAIはサプライチェーンの主要な再設計につながる可能性があります。それにもかかわらず、Goodwillは、AIを用いたより革新的なプロセスを目指しながら、仕分けを最適化するために既存のアプローチに対する段階的な改善に重点を置いています。

エージェントAIを採用するほぼすべての組織が大幅なプロセス再設計を予想していますが、エージェントAIの採用がさらに進んでいる組織は、採用を始めたばかりの組織(42%)よりも、**組織化の方法の変更と職務の再定義を予想する可能性が高く(66%)**なっています。すべての組織がエージェントAIの採用の初期段階にあることを考えると、この違いは重要です。究極的に、エージェントAIの使用は、組織が古いルーティンにAIを追加するだけでなく、新しい働き方を構築することを可能にしています。

これらの相反する要求を積極的に管理する方法:

- 組み込みのオプションを持つプロセスを構築する。 ADPのエージェント構築プラットフォームは、標準化された効率性と何百もの地域での迅速なカスタマイズの両方を可能にします。組織は、一方のアプローチに最適化するのではなく、効率性と適応性のモード間を切り替えることができるワークフローを設計すべきです。

- スコープのエスカレーションを計画する。 Goodwillのテキスタイル仕分けAIは、サプライチェーン全体を再設計する必要性を明らかにしました。組織は、スコープの拡大をプロジェクトの失敗として扱うのではなく、段階的なAI改善がより広範な再設計の議論をいつ引き起こすべきかを決定するための明確なプロセスを確立すべきです。

- スペシャリストとオーケストレーターの両方でチームを編成する。 私たちの調査では、広範囲な採用組織の43%がスペシャリストに代わるジェネラリストの採用を予想し、45%が中間管理職の階層の削減を予想していることが示されているため(付録図1、19ページと20ページを参照)、組織は効率最適化スペシャリストとプロセス再設計ジェネラリストの両方を含むチームを割り当てるべきです。

2. ガバナンスと意思決定権:決定を下し、ルールを設定する

エージェントAIは、これまでのどのテクノロジーとも異なるガバナンスのジレンマを生み出します。ツールは所有され予測可能ですが、人間は自律的であり、監督されなければなりません。エージェントシステムは、その中間のどこかに位置します。これらは資産として所有されますが、従業員と同様に監督を必要とする方法で行動します。

マネージャーにとっての疑問は、もはや「ツールにどうやってガードレールを設定するか?」ではなく、「私たちが所有しているが完全に制御していないアクターに、意思決定権、アカウンタビリティ、および監督をどのように割り当てるか?」です。

私たちのデータによると、主要なエージェントAI組織の58%が3年以内にガバナンス構造の変更を予想しており、AIシステムが意思決定権を持つという予想は250%増加しています。(図3、9ページおよび付録図1、18ページを参照。)これらの組織は、監督 vs. 自律性のジレンマを解決しているわけではありません。彼らは、誰が、あるいは何が、意思決定の責任を負うかについての永続的な曖昧さに対処できるガバナンス構造を作成しています。

制御の緊張は、個々の組織が矛盾するアプローチを同時に実装する方法に最も明確に現れます。Kapireddy氏は、リスクレベルに応じてTruist Bankでヒューマン・イン・ザ・ループとヒューマン・アウト・オブ・ザ・ループの両方のシステムを展開していると説明しており、AIシステムは(人間の監督を必要とする)監督されたワーカーと(独立して動作する)自律的なツールの両方として管理されています。これは、アプローチ間の戦略的な選択ではなく、エージェントAIシステムが両方の管理哲学を同時に必要とするという認識です。

適切な監督を提供するために、組織はAIエージェントがワーカーと同様に、訓練され、指導される必要があることを認識しなければなりません。Citi VenturesのAIおよびAPAC投資責任者であるVibhor Rastogi氏は、これを明確にしています。「この分野のスタートアップを見るとき、私たちは、これらのAIエージェントを、訓練され、指導され、監督される必要がある同僚のように扱うべきだとまだ感じています。ある程度の監督、ある程度の監視、ある程度の監視は、やはり提供されなければならないでしょう。」

しかし、組織はこれらのシステムを自律的に機能できるというまさにその理由で展開しているため、根本的な矛盾が生じます。それは、従業員のように監督されなければならないが、機器のように所有されるシステムです。

経営幹部は、リスク、賭け金、およびコンテキストに応じて、程度の異なる制御を適用できるガバナンスシステムを設計する必要があります。これは、一度バランスを見つけることよりも、継続的に適応できるガバナンス能力を構築することに関係しています。

これらの相反する要求を積極的に管理する方法:

- 意思決定権を明確にする。 組織は、監督と自律性の両方に対応できるガバナンス構造を作成すべきです。Kapireddy氏が、同じAIシステムに対してヒューマン・イン・ザ・ループとヒューマン・アウト・オブ・ザ・ループの両方を使用していると説明するように、企業はIT、HR、およびビジネスユニットが定期的にAIの権限の境界を交渉する正式なプロセスを確立すべきです。このアプローチは、意思決定権を静的なものとして扱い、永続的な制御の決定を行うことを避け、自律性のレベルがワークフローによって異なることを認識します。

- 自律エージェントを展開する前に、集中化されたガバナンスインフラストラクチャを構築する。 AIの意思決定権限において250%の成長が予想されているため、組織は、ビジネスユニット全体に自律システムを展開する前に、全社的なガードレールを備えたガバナンスハブを作成するというSAPのモデルに従うべきです。

3. 組織構造と戦略的な労働力計画:スキルだけでなく、役割を再定義する

従来の組織設計は、人間の努力に焦点を当てた管理の範囲(spans of control)、管理層の階層、キャリアパスを中心に構築されてきました。エージェントシステムは、この論理を根底から覆します。経営幹部にとっての疑問は、もはや単に「どのようなスキルが必要か?」ではなく、「人間とエージェントが並んで働くとき、組織の構造はどのようになるべきか?」です。

私たちの調査データは、構造変化の始まりを示しています。前述のように、エージェントAIを広範囲に採用している組織のうち、45%が中間管理職の階層の削減を予想しています。これは単なる人員調整ではなく、より広範な組織の再設計を意味します。エージェントがワークフローを調整する場合、従来のマネージャーの管理範囲は拡大し、階層の数は減少します。その純効果は、少数の人々がより多くのワーカーを管理するフラットな組織であり、人間のマネージャーは、人間とエージェントのハイブリッドチームを編成する責任をますます負うようになります。

エージェントの採用は、労働力の構成も再形成します。エージェントが機能を超えて学習し、適応するとき、ドメインを横断し、システム全体で機能できるジェネラリストへの需要が高まります。エージェントが日常的なタスクを引き受けるとき、組織はエントリーレベルの従業員を少なくする必要があります。これは従来の労働力最適化ではありません。これは、組織が今や人間と非人間の貢献者の両方を管理していること、そして採用、役割、およびキャリアパスの再調整が必要であることを認識しているということです。

AIの役割に関するデータは、この複雑なシナリオを反映しています。調査回答者は、今後3年間でAIがアシスタントや同僚、メンターやコーチのようになることを予想しています。(図2、6ページを参照。)この役割の進化は、AIがワーカーなのかツールなのかという問題を解決しません。それは、組織が同時に管理しなければならないアイデンティティのカテゴリを増殖させることになります。

これらの進展は、既存のキャリアアップの概念に課題を投げかけるでしょう。日常的な分析や調整を中心とした昇進および報酬システムは、陳腐化する可能性があり、組織は新しい能力に報いることを余儀なくされます。例えば、ハイブリッドチームの編成、例外の管理、倫理的監督の提供などです。この将来において、「ジェネラリスト」はジュニアや経験不足を意味するのではなく、ドメインを横断し、曖昧さを管理し、人間とAIのコラボレーションを大規模に監督できるリーダーを指します。

エージェントAIを広範囲に採用している組織では、回答者の95%がAIが仕事の満足度に肯定的な影響を与えたと示しており、このアイデンティティの混乱を狭く分類しようとするよりも、解決するのではなく受け入れることがより良い結果を生み出すことを示唆しています。

これらの相反する要求を積極的に管理する方法:

- 組織構造を再構築する。 予想される組織的なシフトは、よりフラットな階層とより広い管理範囲を計画し、マネージャーの役割を、情報仲介に焦点を当てるのではなく、ハイブリッドな人間とAIのチームを編成することに焦点を当てるように再定義する必要性を示しています。

- 労働力パイプラインに二重のキャリアパスを作成する。 AIを広範囲に採用している組織のうち、43%がより多くのジェネラリストを採用することを計画しており、29%がエントリーレベルの役割の減少を予想しています。(付録図1、20ページを参照。)これは、組織がAIで強化されたスペシャリストとAIオーケストレーターの両方のために、明確な昇進パスを確立すべきであり、両方の役割が不可欠であることを認識していることを示唆しています。

- チームにおけるAIの進化する役割を計画する。 組織は、AIがコーチやメンターとしてますます機能することを予想しています。これに備えるために、組織はこれらの役割の変化を予期する労働力モデルとリーダーシップ育成プログラムを構築し、人間がより指導的かつ判断志向の役割でエージェントと協働する準備ができていることを確実にすることができます。

4. スキルアップ、学習ループ、およびライフサイクル管理:人間とエージェントの能力構築

エージェントAIの利用は、組織が学習と能力開発について考える方法を2つの側面で再構築する必要があります。

- 従業員は、 AIシステムの技術的な使用だけでなく、それらの監督、批評、および編成においてスキルアップを必要とします。

- エージェント自体も、信頼性と価値を維持するためには、ライフサイクル管理(オンボーディング、トレーニング、再トレーニング、および最終的な引退)が必要です。

経営幹部は、「いかにして、人々とエージェントが継続的に学習していることを確実にしているか?」と継続的に自問すべきです。

人間側では、従来のリスキリングは、人々にツールの操作方法を教えることに焦点を当てていました。しかし、エージェントと並んで働くことは、より広範な能力を要求します。従業員は、いつ出力(アウトプット)を信頼すべきか、いつそれに異議を唱えるべきか、そしてそれをチームのワークフローにどのように統合すべきかを知る必要があります。

エージェント側では、これらのシステムは経験とともに価値を高めることができ、適切に管理されれば複合的な効果を生み出します。組織は、エージェントを静的なツールとしてではなく、人間の従業員に提供されるのと同様の構造化されたサポートを必要とする、独自のライフサイクルを持つ動的な参加者として扱う必要があります。

Connor氏は、Chevronではモデルのアップデートが「数か月ごと」に届くと述べており、システムを最新の状態に保つための継続的な警戒の必要性を強調しています。Natarajan氏は、エージェントが軌道を外れないようにするためのCapital Oneでのファインチューニングへの継続的な再投資を指摘しています。組織がエージェントのケアを積極的に怠ると、システムはすぐに古くなったり、不正確になったり、あるいは危険になったりするでしょう。

HRチームが従業員を採用、オンボーディング、トレーニング、評価、そして最終的に引退させるのと同様に、エージェントAIを採用する組織は、非人間的労働力のための並行したサポート機能を必要とします。

これらの機能には、オンボーディングプロセス(新しいエージェントのテストと検証)、業績評価(エージェントの正確性、適応性、およびバイアスの追跡)、再トレーニング(新しいデータが利用可能になったときのエージェントのファインチューニング)が含まれます。一部の企業は、これに対して明確なアカウンタビリティ(責任)を割り当てる実験を行っています。例えば、Modernaは、技術部門と人事部門を統合し、エージェントが単なるITインフラではなく、労働力の一部として管理されなければならないことを明確にしました。

これらの相反する要求を積極的に管理する方法:

- 人間を操作するだけでなく、編成するためにスキルアップさせる。 組織は、従業員にエージェントの出力を単に消費するだけでなく、監督、方向転換、および批評するように訓練しなければなりません。

- オンボーディングを再設計する。 エージェントはトレーニングプログラムに組み込まれ、新入社員が初日から彼らと働くことを学ぶようにすべきです。

- 「エージェントのための人事(HR for agents)」機能を作成する。 組織は、HRが人間に対してこれらの機能を提供するのと同様に、AIエージェントの採用、オンボーディング、評価、再トレーニング、および引退に対する責任を割り当てなければなりません。

5. 投資戦略:永続的な不確実性のための予算編成

従来の投資フレームワークは、組織が競合するアプローチ、すなわち資本支出と運営費、短期的リターンと長期的リターン、集中型支出と分散型支出の間で選択できることを前提としています。しかし、エージェントへの投資はこれらのカテゴリを横断するため、組織は複数の投資アプローチに対応できる財務アーキテクチャを必要としています。

エージェントAIの急速な進化は適応性を必要とします。新しいモデルや機能の急速な出現に伴い、投資の決定は、切り替えコストを予測し、システムへの継続的な再投資を計画しなければなりません。財務モデルは、組織を静的な減価償却スケジュールに固定することなく、迅速なアップグレード、再トレーニング、および交換を考慮に入れるのに十分な柔軟性を持つべきです。

ほとんどの資本投資とは異なり、エージェントAIは使用とともに価値を高める(Appreciate)ことができます。マネージャーがエージェントをファインチューニングし、より多くのデータに晒し、ワークフローに組み込むにつれて、エージェントシステムはより効果的になることができます。ほとんどのテクノロジーは時間の経過とともに有用性が停滞または低下しますが、エージェントシステムは、モデルのドリフトや技術的な変化の可能性にもかかわらず、使用されるほどに価値を高めることができます。組織はこれらのシステムを使用して、よりプロアクティブになり、市場のシグナルをより早く見つけ、効率性だけでなく差別化で競争することができます。この価値の向上は、従来の投資ロジックからの戦略的な逸脱を必要とします。

組織は、顧客と価値の視点に投資を固定すべきです。問題は、単にAIにどのように資金を供給するかではなく、それが提供することを意図している価値がコスト効率、より速いイノベーション、またはより深い顧客エンゲージメントであるかということです。私たちの調査によると、採用がさらに進んでいる組織は、競争上の差別化の方法における根本的な変化を予想する可能性がはるかに高いことが示されています。これは、彼らの投資の選択が、分断されたプロジェクトの寄せ集めに分散されるのではなく、戦略的な目標に直接結びつけられることを要求します。

これらの相反する要求を積極的に管理する方法:

- 適応性のために構築する。 組織は、急速な技術的変化があることを想定し、したがって、切り替えコストを組み込み、継続的な再トレーニングをサポートできる予算とシステムを設計すべきです。

- 機能間の意見の不一致/共同での整合性に対応する投資レビュープロセスを作成する。 組織は、IT、財務、HR、およびビジネスユニットが、合意を必要とせずに、矛盾する投資アプローチを提唱できる月次レビューサイクルを確立すべきです。

- 競合する価値創造の源泉を追跡するメトリクスを開発する。 組織は、AIシステムを価値を高める資産(学習能力、拡張されたアプリケーション)と価値を減らすツール(モデルのドリフト、技術的陳腐化)として同時に測定し、そのようなメトリクスが時として反対の方向を指すことを受け入れるべきです。

結論

エージェントAIにより、リーダーは歴史的な前例のない新しいエンティティを管理しています。それは学習するツールであり、所有されるワーカーであり、ツールとワーカーの両方のように振る舞う投資です。エージェントAIは、代替品または補完品というフレームワークにきれいに収まりません。なぜなら、それはワーカーとツールの両方として同時に管理されることを要求するからです。代替品・補完品フレームワークは、「AIは同僚を置き換えているのか、それとも強化しているのか?」と問います。しかし、エージェントAIは、より不安な質問を強います。「私たちは、機器のように所有するが、人のように監督しなければならず、機械のように減価するが、人間のように学習する人工的な同僚をどのように管理するのか?」この新しいテクノロジーは、重要な設計上の課題を生み出します。

エージェントAIを使い始めている企業は、すでにその問題に取り組んでいます。一部は、これを主にコスト削減の方法として扱っていますが、他の企業は、能力を拡大し、実験を加速し、人々の基本性能を高めるために使用しています。リーダーは、何を最適化しているのかを明確にし、それに応じてプロセス、構造、およびガバナンスを設計する必要があります。

エージェントAIの展開を従来のツールのように扱うと、その柔軟性の利点を見逃しますが、新しく採用されたスタッフのように扱うと、インフラストラクチャの要件を過小評価することになります。この二重のリスクは、柔軟性と効率性、制御と自律性、初期投資と継続的な学習の間の避けられない緊張を生み出します。成功は、これらの対立を排除することではなく、それらを習得することによって定義されるでしょう。

エージェントAIの課題は、技術的ではなく、組織的です。多くの組織は、一貫した戦略が確立される前に、猛烈なペースでこのテクノロジーを採用しています。しかし、採用のスピードは進歩の尺度ではありません。優位性は、組織に最高のAIをできるだけ早く注入することからではなく、「私たちは、それ(AI)を中心にして組織をどのように再編成するか?」という問いに対する最良の答えを持つことから生まれるでしょう。「今採用し、後で戦略を立てる」というアプローチは、組織の戦略によく適合するエージェントAIの目的を特定するという骨の折れる作業を避ける、ハイリスクな賭けです。

最終的に、この課題は深く人間的であり、企業が組織のサイロを打ち破ることを必要とします。テクノロジーをIT部門内でのみ管理する時代は終わりました。ガバナンスは今や、IT、HR、財務、およびオペレーションが一元化されたフレームワークで協力しなければならない、必須の部門横断的な取り組みです。エージェントAIは、人間の判断を排除するのではなく、高めます。AIエージェントが以前は人間のワーカーによって行われていたタスクを処理するにつれて、戦略的監督、倫理的ガバナンス、および人間とAIのチームを編成する能力が最も重要な人間のスキルとなります。成功する組織は、テクノロジー自体よりも、それを取り巻く人間システムに焦点を当てる組織となるでしょう。

これは、今日のリーダーにとって深く不安にさせる質問を強います。「私たちは単にビジネスに新しいツールを追加しているのか、それとも組織に新しい非人間的なアクター(行為主体)を導入しているのか?」私たちの対応が、次の時代の管理を定義するでしょう。

単一システムにおけるツールとワーカーの融合

SAPのSun氏は、エージェントAIが複雑なタスクを処理するために、人間ワーカーレベルの専門知識を提供する能力を身につけていると見ています。

彼は次のように説明します。「私の見方では、非常に大きな百科事典にアクセスする選択肢と、特定のタスクの専門家である人にアクセスする選択肢があった場合、どちらを選びますか?私たちは、多くのビジネスタスクにおいて、その専門家が必要だと感じています。だからこそ、ファインチューニングを行い、これらのより小さな言語モデルを作成することで、その専門知識がAIエージェントに組み込まれると考えているのです。」

初期のモデル(百科事典)は減価する固定資産ですが、継続的なファインチューニングのプロセスを通じて、それはより価値のある、柔軟な「専門家」になります。

起業家の専門知識を、彼らの核となる強み以外の分野の専門知識で補強するために、Alibaba.comは中小企業向けに4つのエージェントシステム(製品リスト作成、コミュニケーション、マーケティング、リスク管理)を開発しました。しかし、これらのエージェントは固定された働き方に縛られていません。

むしろ、同社のKuo Zhang社長は、「各エージェントは、この仕事をしている実際の人間の90%を凌駕できます。エージェントとより多く協働するほど、あなたのビジネスをより理解するのです」と述べています。

この開発は当初、ツールのような設計を必要としましたが、通常は人間のワーカーに関連付けられている利点を保持しました。経験が増すにつれて、エージェントは特定の状況についてますます学習しています。その結果、小規模な起業家は、自分たちの文脈で直面する問題を処理するために、エージェントをますます利用できるようになっています。

免責事項

記事は、一般的な情報提供のみを目的としてのみ作成したものであり、投資家に対する有価証券の売買の推奨や勧誘を目的としたものではありません。また、記事は信頼できると判断した資料およびデータ等により作成しておりますが、その正確性および完全性について保証するものではありません。また、将来の投資成果や市場環境も保証されません。最終的な投資決定は、投資家ご自身の判断でなされますようお願いします。